Son aylarda SEO’da çok dikkat çeken konulardan biri robots.txt’deki Noindex yönergesiyle nasıl başa çıkılacağı sorusudur. Pek çok SEO tarama ve indeksleme kontrolü için noindex kullanır, ancak bu yakın zamanda geçmişte kalmayacak.

Web yöneticisi Central Blog’da Google, 2 Temmuz 2019’da, Eylül’den itibaren artık robots.txt’de Noindex’i kullanmayacaklarını açıkladı . Bu duyuruya dayanarak, bazı web siteleri zaten robots.txt dosyasını temizlemeye ve Noindex bilgilerini silmeye başlamıştır . Bununla birlikte, bu makalede, noindex kaldırmanın acil sonuçları olabileceğini gösteren bir vaka sunuyoruz. Kendimizi, Google’ın bu çözümü kaldırmanın gerçekten iyi bir fikir olup olmadığını sorduğunu görüyoruz.

Noindex’in robots.txt içerisindeki faydaları

SEO’da, robots.txt ile nasıl başa çıkılacağı konusunda birçok farklı görüş var ve bu konu hakkında yıllar boyunca birçok tartışma yapıldı. Bazı insanlar 2008’de Matt Cutts tarafından sunulan çözüm seçeneğine güveniyor , diğerleri ise bu direktifin asıl faydaları konusunda şüpheliydi.

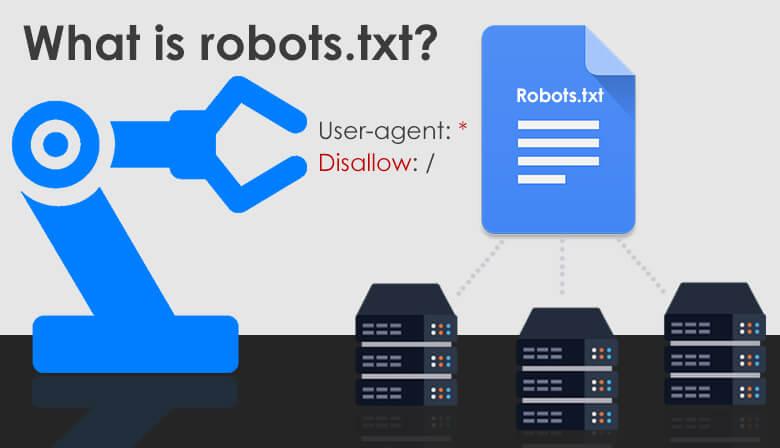

Robots.txt dosyasındaki Noindex özelliği (HTML kafasındaki (Meta Robots) veya HTTP Yanıt Başlığı’ndaki (X-Robots) Robots etiketi ile karıştırılmamalıdır) Disallow yönergesine benzer şekilde çalışır. Bununla birlikte, Noindex etiketi, Disallow işlevi URL’lerin endekslenmesini önleyemediğinden, Google dizinine girerek engellenen URL’lerin engellenmesinden daha iyidir. Prensip olarak, eğer bir URL taranamazsa, endekslenemeyeceğini beklersiniz. Bununla birlikte, deneyimler Disallow’un URL’lerin endekslenmesini önleyemediğini göstermiştir. Bu aynı zamanda Google’ın dokümantasyonu ile de yedeklenir .

Şekil 1: Bir robots.txt bloğu nedeniyle sayfa bilgisi olmadan örnek Google arama sonucu

Geçmişte robots.txt dosyasında Noindex özelliği ile çalışanlar, bu tür istenmeyen endekslemeyi önleyebileceğini bulmuşlardır . Deneyimler, bu direktifin dizine alınmış URL’leri arama motoru dizininden kaldırdığını göstermiştir. Ancak, bu bir garanti değildi.

Google’ın sunduğu alternatifler neden seçenek değildir?

Robots.txt dosyasındaki Noindex, bir web sitesinin taranmasını ve endekslenmesini aynı anda belirli durumlar için optimize etmenin en iyi yollarından biriydi. İdeal olarak, kaynak kodunda sinyaller almak yerine, temiz bir teknik uygulama ile optimal bir tarama ve indeksleme gerçekleştirilmelidir. Bununla birlikte, deneyimler bunun genellikle kısa bir sürede elde edilemeyeceğini göstermektedir.

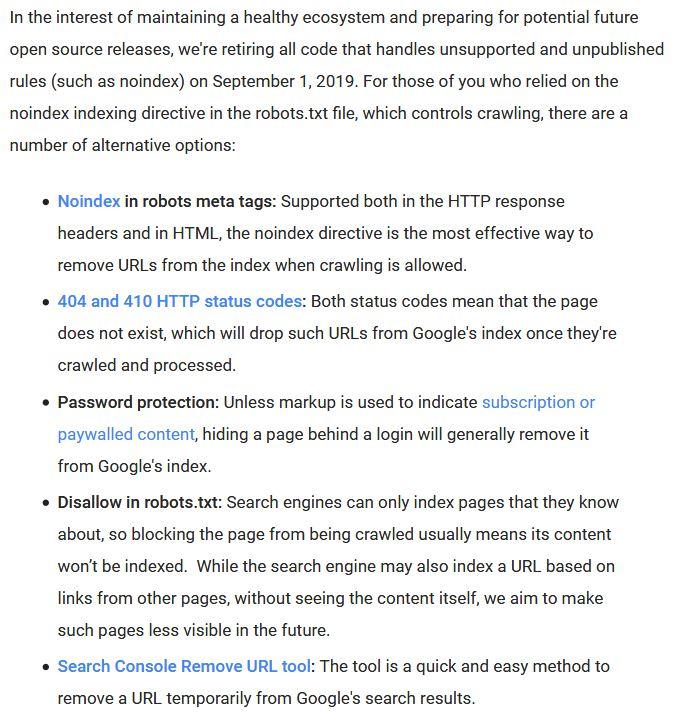

Bu nedenle, Google’ın Noindex yönergesini Eylül ayında robots.txt dosyasından çekeceği üzücüdür. Google aşağıdaki alternatifleri önerir:

Şekil 2: Google’a göre robots.txt’deki Noindex’e alternatifler

Bence, Google’ın Web Yöneticisi Merkezi Blog yayınında belirtilen yukarıdaki seçenekler çok anlaşılmaz ya da çok iyi anlaşılmıyor:

- Meta-Robots-Tag “noindex”: Bu, URL’lerin Google’ın dizinine dahil edilmemesini veya ondan kaldırılmasını sağlar. Ancak, URL’ler hala taranabilir ve en kötü durumda da tarama bütçesini olumsuz yönde etkileyebilir. Bu seçenek bu nedenle çoğu durumda söz konusu değildir.

- 404 veya 410 HTTP durum kodu: Bir URL’nin artık olmaması gerekiyorsa, 404 veya daha da iyisi, 410 HTTP durum kodunun kullanılması bir olasılıktır. Bununla birlikte, ideal değildir ve robots.txt dosyasındaki noindex’e alternatif olarak bir hata kodu sunmak mantıklı değildir.

- Şifre koruması: Bu öneri aynı zamanda% 99 da çalışmaz. Aşamalı ortamında bir web sitesi için, elbette, endekslemeden kaçınmak için en iyi kurulum şifre korumasıdır. Ancak Google, bir örnek vermeden bunu alternatif olarak önermemelidir.

- URL kaldırma işlevi: Google Arama Konsolundaki bu işlev, prensip olarak URL’leri endeksten kısa sürede kaldırmak için harika bir araçtır. Bununla birlikte, istenmeyen URL’lerin arama sonuçlarından çıkması için aracın daha da genişletilmesi gerekir.

- Robots.txt dosyasında izin verme: Yukarıda açıklandığı gibi, geçerli İzin Verme özelliği, URL’lerin endekslenmesini tamamen engellemez. Umarım, Google, “bu tür sayfaları gelecekte daha az görünür kılmayı hedefliyoruz” ifadesiyle Disallow komutunu geliştirecektir.

Google’ın robots.txt’deki Noindex’i değiştirmesinin sonucu

Mevcut alternatiflerden memnun olmasanız bile, bir web sitesi operatörü olarak robots.txt kodunuzu önümüzdeki birkaç hafta içinde ayarlamanız ve Noindex spesifikasyonu olmadan yapmanız gerekecektir. Bu çok önemlidir, çünkü robots.txt doğru bir şekilde yorumlanamıyorsa, bu diğer tüm direktiflerin tarayıcı tarafından göz ardı edilmesine neden olabilir. Bunun Google için de geçerli olup olmadığı henüz bilinmiyor.

Robots.txt komutunun sırasını izlerseniz, yani önce Disallow, ardından İzin Ver ve sonunda yalnızca noindex kullanıyorsanız, bu yönergeyi diğer arama motoru tarayıcılarına vermeye devam ederseniz, kesinlikle geçerli statükoyu korumayı düşünebilirsiniz – robots.txt dosyasındaki Noindex ile çalışıyorlarsa. Her iki durumda da, tarama ve dizine almadaki değişikliklere dikkat etmek için kesinlikle uygun bir izleme ayarlamanız gerekir .

Noindex’in robots.txt dosyasındaki erken kaldırılması ne yapabilir

O zamana kadar ortaya çıkacak kritik soru: Robinde.txt içindeki Noindex direktiflerini zaten kaldırırsanız ve sadece Disallow’a güvenirseniz ne olur? Müşterilerimizden biri, Google’ın iletisini yayınlamasından yalnızca bir hafta sonra robots.txt dosyasını ayarladı ve yalnızca önceki Disallow yinelenen girişlerini sakladı.

Robots.txt dosyasındaki değişiklikten sonra nispeten hızlı bir şekilde Google, endekste Noindex özelliği tarafından daha önce engellenmiş olan bazı URL’leri eklemeye başladı. Disallow yönergesi hala bu URL’lerin taranmasını engelliyor, ancak Google’da endekslenmeyi önlemek için yeterli değil. Bu durum bize robots.txt dosyasındaki Noindex’in ne kadar etkili olduğunu bir kez daha gösterdi!

Bu durum Noindex etiketinin önemini gösteriyor, bu nedenle Eylül ayından itibaren birlikte çalışamayacağımıza üzülüyoruz. Umarım, Google, robinde.txt’deki Noindex’in avantajlarını gelecekte Disallow spesifikasyonuna aktaracaktır.

Sonuç

Sunulan durumdan görebileceğiniz gibi, varolan noindex direktiflerini önlemek için robots.txt ayarını erken yapmanız önerilmez. En kötü senaryoda, Disallow yönergesi ile engellenen URL’ler endekslenecektir.

Hangi değişikliklerin tam olarak 1 Eylül 2019’da gerçekleşeceğini bilmiyor olsak da, robots.txt dosyanızı Eylül tarihine mümkün olduğunca yakın ayarlamanızı öneririz. Ayrıca robots.txt dosyasında engellenen URL’lerin dizin izlemesini öneririz.

Ayrıca, tarama ve dizine alma arasında en uygun dengenin çözümü, web sitesi düzeyinde teknik olarak temiz bir uygulama olmaya devam ediyor. Burada sunulan örnekle ilgili sorun, GoogleBot’un kaynak kodunda GoogleBot’un söz konusu URL’leri taramasını veya dizine eklemesini istemesine neden olan bir dizi sinyal olmasıdır. Bu mutlaka href veya form bağlantıları anlamına gelmez.

Günlük dosyası analizleri, URL parçacıklarının komut dosyalarındaki, yorumlardaki veya kendi tanımladığınız HTML niteliklerindeki kodlarının Google’ın bu URL modellerini taramasına ve dizine eklemesine neden olabileceğini göstermiştir. Bu, bir kez daha SEO’da temiz programlamanın önemli olduğunu ve tarama kontrol aracı olarak yalnızca robots.txt dosyasına güvenmemeniz gerektiğini açıkça ortaya koyuyor. Teknik olarak en uygun şekilde konumlandırılması için, bağlantı maskeleme, PRG desenleri ve benzeri gibi önlemler hala gerekli adımlardır.